L'intelligence artificielle perpétue-t-elle des stéréotypes racistes ?

Et si l'intelligence artificielle était... raciste ? C'est ce qu'ont démontré plusieurs chercheurs américains dans de récents travaux.

Pour fonctionner, l'IA nécessite la récolte de nombreuses données tirées de contenus déjà existants sur le web tels que des travaux scientifiques, des articles de presse, des blogs ou encore des forums. Cependant, les sources de l'IA semblent se limiter à la culture occidentale (et surtout américaine), n'intégrant pas suffisamment l'ensemble des cultures des quatre coins de la planète à son corpus de données. Cette prédominance culturelle a, aux yeux de différents chercheurs universitaires, un certain effet sur l'objectivité des outils exploitant l'intelligence artificielle (qu'elle soit générative ou non).

Selon l'organisme indépendant ProPublica, spécialisé en journalisme d'enquête d'intérêt public, l'exemple de l'outil à base d'IA exploité par les tribunaux américains afin d'évaluer la probabilité de récidive des criminels - le programme Compas - en est l'illustration : "Notre analyse a révélé que les accusés noirs qui n'ont pas récidivé sur une période de deux ans étaient près de deux fois plus susceptibles d'être classés à tort comme à risque plus élevé que leurs homologues blancs (45 % contre 23 %)", précise ProPublica dans son rapport.

De même, l'organisme a remarqué que les accusés blancs qui ont récidivé au cours des deux années suivantes leur libération ont été étiquetés à tort comme à faible risque presque deux fois plus souvent que les récidivistes noirs (48 % contre 28 %). "L'utilisation d'outils de prédiction de la récidive dans les tribunaux devrait être remis en question. Les affirmations selon lesquelles des outils opaques et soi-disant sophistiqués sont plus pertinents et justes que les humains ne correspondent tout simplement pas aux résultats de nos recherches", affirme Julia Dressel, professeur d'informatique au Dartmouth College, dans un communiqué.

La Barbie allemande générée avec... un uniforme SS !

Un autre exemple montre que les stéréotypes peuvent parfois être repris - de manière très dommageable - par l'intelligence artificielle : celui de l'outil Vision AI de Google. Effectivement, selon Algorithm Watch, l'application de vision artificielle avait tendance à identifier un fusil dans une image où un homme de couleur tenait un thermomètre portatif. À l'inverse, pour un homme à la peau plus claire, l'outil reconnaissait... un appareil électronique !

Dans le même esprit, le média américain Buzzfeed a dévoilé, en juillet dernier, les résultats d'une expérience assez édifiante : un journaliste a demandé à l'outil Midjourney de générer des images par l'IA de ce à quoi "la poupée Barbie ressemblerait dans tous les pays du monde". Résultat ? Les pires stéréotypes ont été reproduits : la Barbie allemande portait un uniforme SS, la Barbie sud-soudanaise tenait une arme à feu et la Barbie libanaise se tenait devant un bâtiment en ruines...

L'IA moins efficace pour reconnaître des personnes de couleur

Une étude du MIT, publiée en février 2018, a, parallèlement, révélé une forte hétérogénéité d'efficacité pour la reconnaissance faciale selon l'ethnie et le genre de la personne analysée. En effet, les principaux logiciels de reconnaissance faciale ont une marge d'erreur de moins de 1 % pour les hommes blancs, contre 35 % pour les femmes noires. Et cela peut parfois avoir des répercussions assez graves : en janvier 2020, un Afro-Américains a passé 30 heures en détention à cause d'un logiciel qui avait confondu la photo de son permis de conduire avec l'image d'un voleur de montres capturé par des caméras de surveillance.

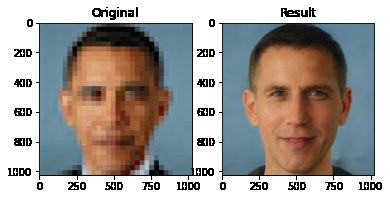

Autre phénomène identifié : l'intelligence artificielle a la fâcheuse tendance à "blanchir" les personnes de couleur. C'est le cas de Pusle, un modèle capable de déflouter les images grâce à l'IA, notamment exploité par l'outil Face Depixelizer. Selon les observations de nombreux internautes, le visage flouté d'un homme blanc est fidèlement reconstitué, contrairement à celui d'une personne de couleur.

Pour cette dernière, le teint généré est largement plus clair que ce qu'il ne l'est en réalité. Certaines mises à jour des données de l'intelligence artificielle, qui prendraient davantage en considération ces problématiques, ne seraient pas superflues. Doux euphémisme...

© Copyright 2026 IBTimes FR. All rights reserved.